看到这只羊驼了吗,它就是 Ollama

使用 AMD 显卡通过 Ollama 部署 DeepSeek-r1 LLM 时,它默认使用 CPU 和内存进行推理

CPU 吃得很满不论, token 生成速度也并不理想

遍览网上教程,方晓 AMD 的卡也可以 ROCm 直接跑 LLM

故作此文以记之

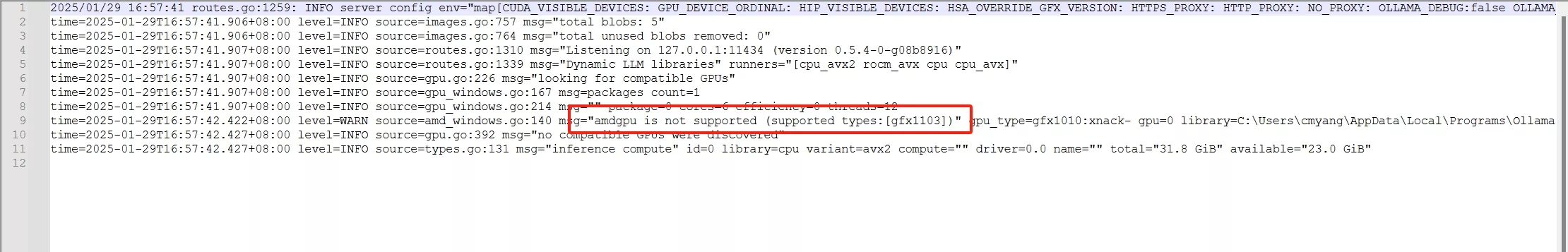

一、检查 Ollama 是否调用显卡

查看 Ollama 日志

单击菜单栏 Ollama 的图标,点击 “view logs” 查看 Ollama 日志

直接运行大模型

可以直接使用命令

ollama run deepseek-r1:8b --verbose运行大模型,然后问它一些问题,看看CPU和GPU的占用。

二、教程

首先确认目前的 AMD 显卡是否支持 ROCm

访问按摩店官网 rocm.docs.amd.com ,查看是否有你目前的显卡型号,若有,再看一下列表后面的 HIP SDK 一列是否支持,两者均满足就可以直接下载 AMD 官方版本 ROCm 和 Ollama 官方版本搭配现有显卡使用。

如果没有看到你的显卡或者不支持,就需要使用下面的方法

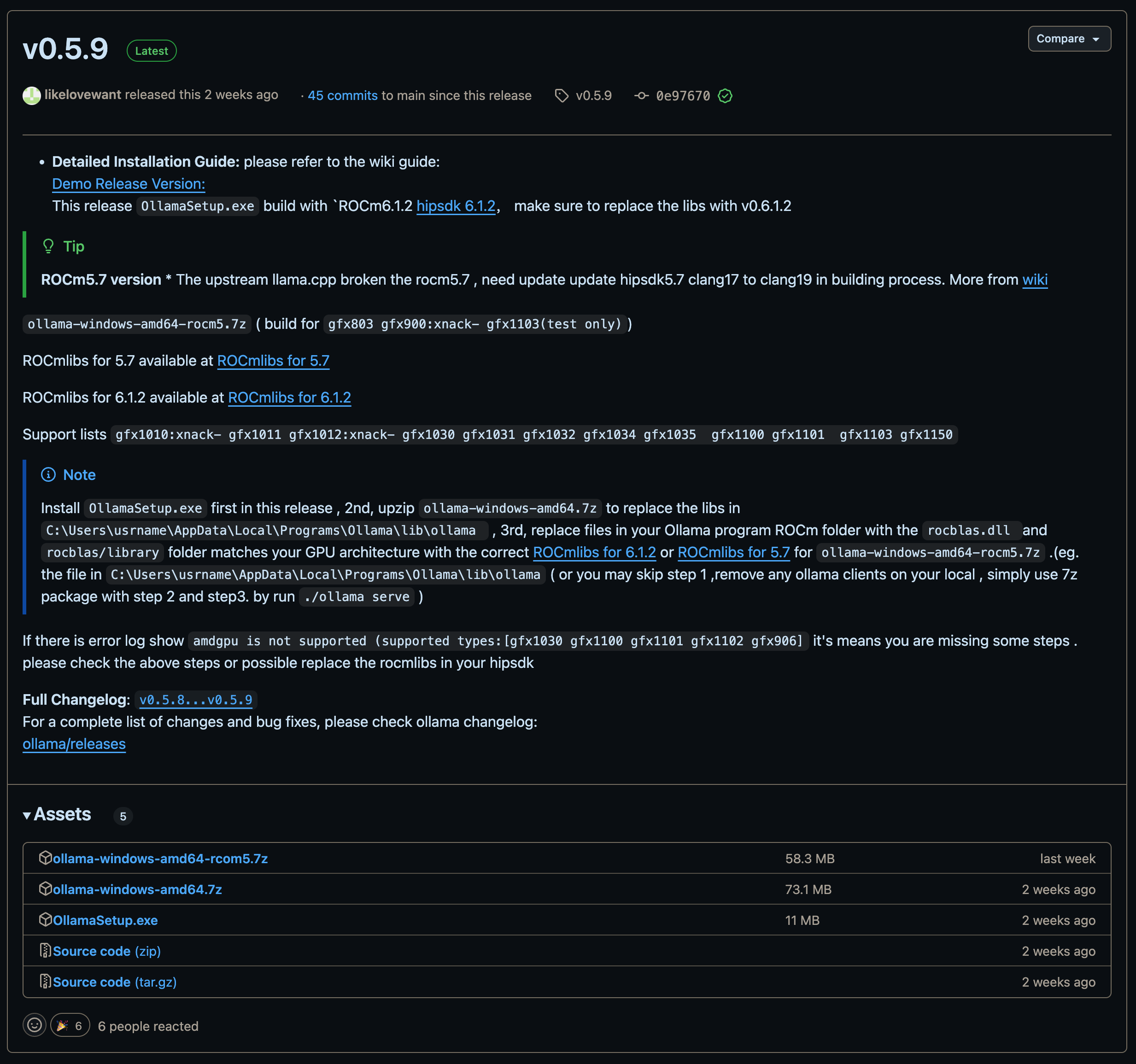

安装 Ollama-for-amd

下载地址:ollama-for-amd

在安装前,需要卸载已经安装好的 Ollama

根据显卡类型下载 ROCmlibs for 6.2.4

下载地址:Rocmlibs for 6.2.4

这里下载的 rocmlib2 要根据之前在日志文件中看到的gpu类型来决定,例如我的5700XT对应

gfx1010

替换文件

解压刚才下载的 rocmlibs for 6.2.4,替换对应文件到 Ollama 安装目录。

ollama 安装目录:C:\Users\你电脑的用户名\AppData\Local\Programs\Ollama\lib\ollama

压缩包的rocblas.dll替换ollama安装目录下的:C:\Users\你电脑的用户名\AppData\Local\Programs\Ollama\lib\ollama\rocblas.dll

压缩包中的library文件夹替换ollama安装目录下的:C:\Users\你电脑的用户名\AppData\Local\Programs\Ollama\lib\ollama\rocblas\library重启 Ollama

重新运行 ollama ,查看 server.log 日志中的 GPU 信息

这里已经能够显示出 GPU 的参数信息了

运行大模型并提问,发现已经能够使用 GPU 进行推理了。